ウェブ会議からウェブ面接、オンライン診療、オンライン授業、オンラインイベントに至るまで。コロナ禍においては「ビデオ」が日々の生活において重要な役割を担うプラットフォームになりつつある。

ビデオを用いたコミュニケーションではパソコンに内蔵されたウェブカメラにしろ、高品質なビデオカメラにしろ、何らかのカメラを用いて行う。ここに最新のテクノロジーを取り入れることで、普段のビデオ会議やビデオコミュニケーションをよりリッチにできないか──。9月28日に公開された「xpression camera(エクスプレッションカメラ)」はそんな思想から生まれたバーチャルカメラアプリだ。

同サービスの特徴は動画や画像の中の人の顔を乗っ取り、自分の表情に合わせてリアルタイムで動かせること。素材は実在する人物の写真、偉人のイラスト、キャラクターの動画など何でもよく、もちろん自分の写真でも構わない。

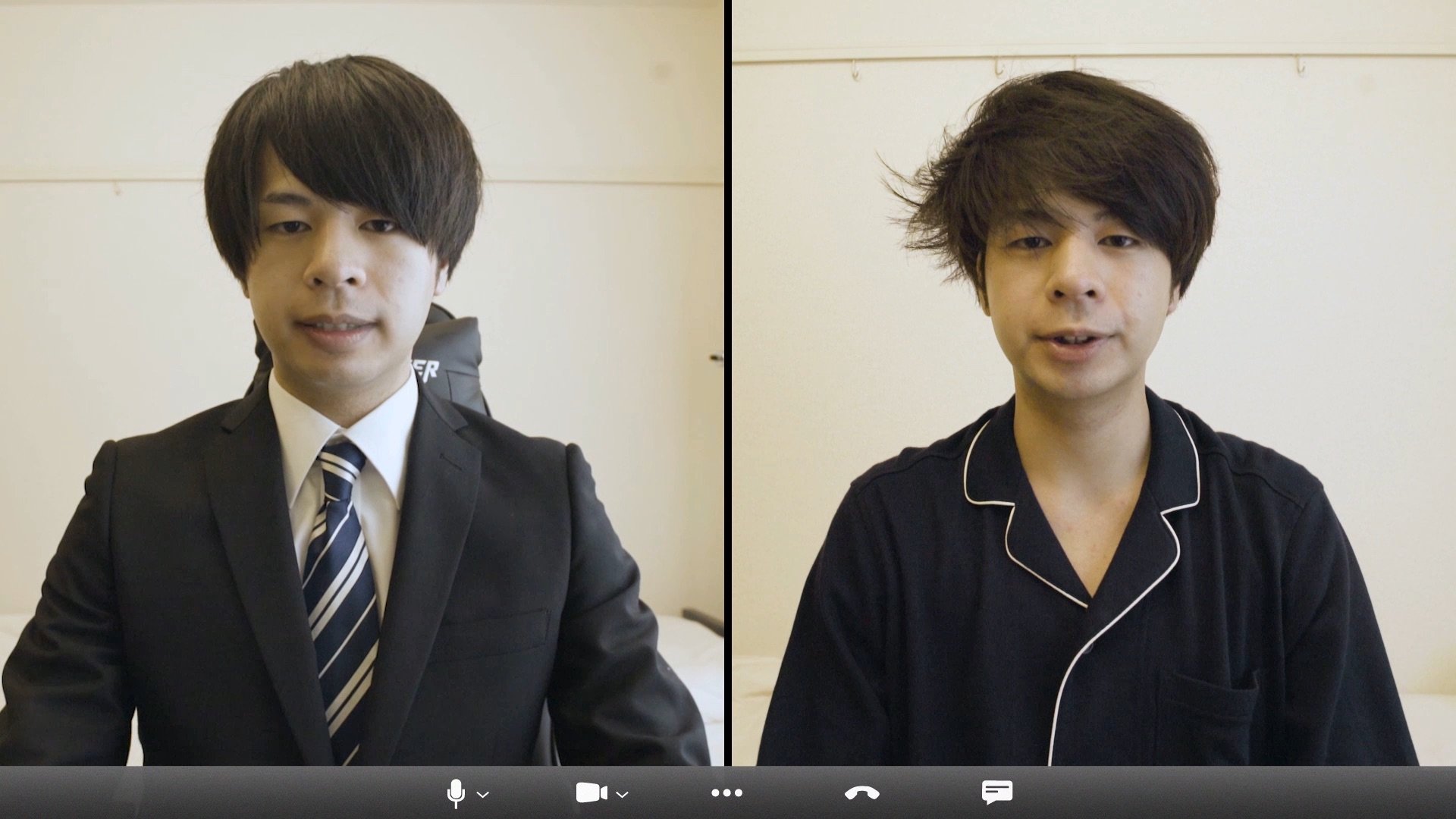

たとえばスーツ姿の自分が写った写真をあらかじめ準備しておくけば、実際はパジャマ姿でウェブ会議に参加していても“ちゃんとした雰囲気”を醸し出すことも不可能ではない。

スーツ姿の自分の画像を使ってパジャマでZoom会議も

xpression cameraの使い方はシンプルだ。Mac用のカメラアプリを開いて、動かしたい顔の写真や動画を1つアップロードするだけ。自分で用意した素材に加えてアプリに標準で搭載されている素材なども使うことができる。